Publiziert am 01/07/2020

Sich dieser Tage mit Luca Finelli zu verabreden, ist alles andere als einfach. Der studierte Physiker, der das als SENSE bezeichnete Konzept der Kontrollstelle für klinische Studien ersann, steckt bis zum Hals in Arbeit. Denn seine Aufgabe besteht darin, die Digitalisierung von Novartis zu beschleunigen und die Nutzung von auf künstlicher Intelligenz (KI) basierenden Tools – darunter auch maschinelles Lernen – konzernweit zu erhöhen.

Neben vielen weiteren aktuellen Aufgaben unterstützen Luca Finelli und sein Insights Strategy and Design Team (ISD) Novartis Technical Operations dabei, dessen globale Prozesse, die mehr als 60 Produktionsstätten einschliessen, zu digitalisieren. Ebenso helfen sie Global Drug Development, die Finanzplanung der zahlreichen klinischen Tests, die die Division Jahr für Jahr durchführt, zu ordnen und mit prädiktiver Analytik zu unterlegen, um zukünftige Entwicklungen vorauszusehen.

Ganz ähnlich wie bei der Plattform SENSE, die Novartis ermöglicht, bei ihren über 500 laufenden klinischen Studien den Überblick zu bewahren und Fortschritte in Echtzeit zu bewerten, zielt das konzerninterne ISD-Team um Davide Franco, Gernot Weber, Robert McGregor und David Heard darauf ab, umständliche und manuelle Verfahren in schnelle und prädiktive Prozesse umzuwandeln.

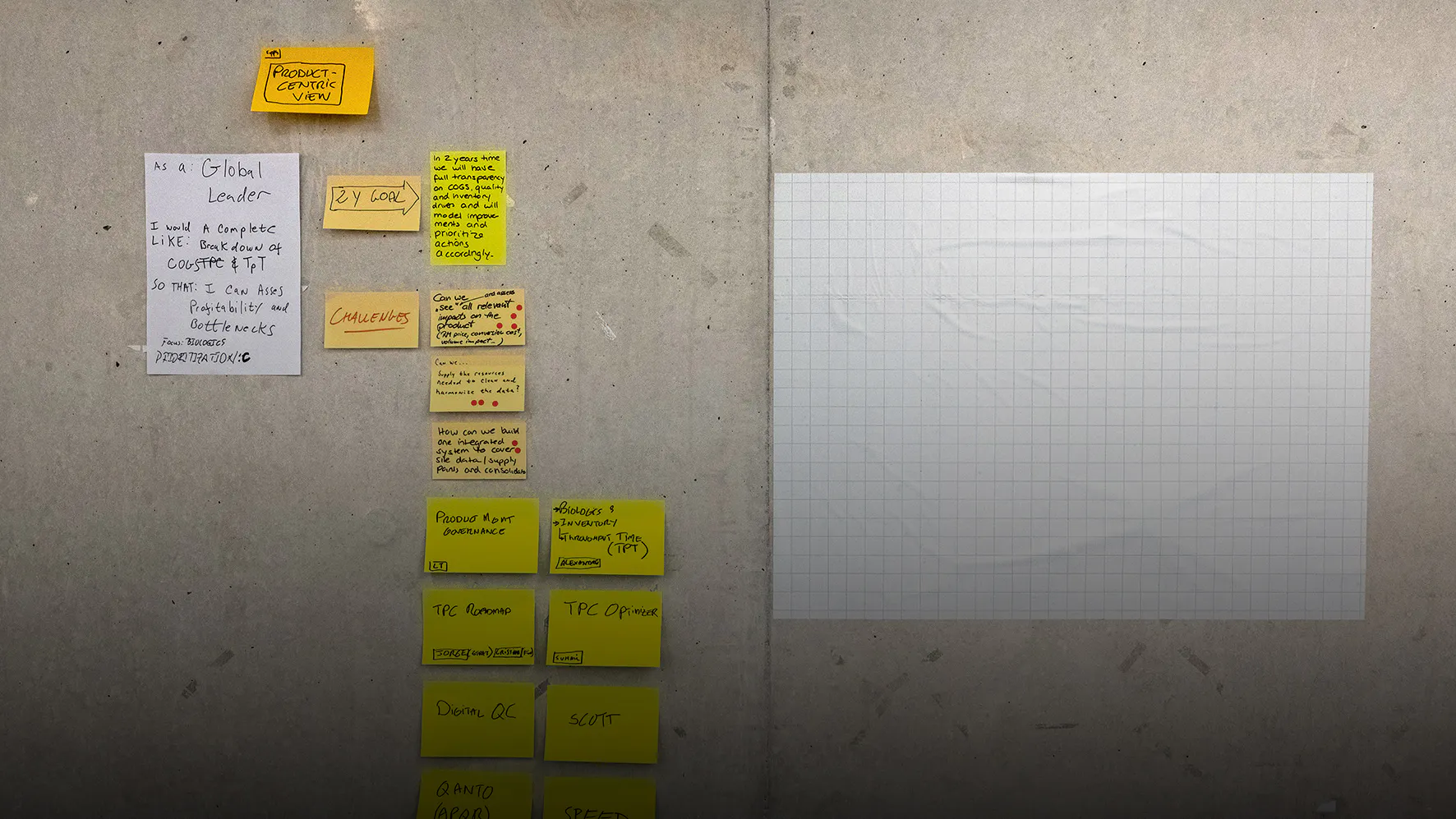

Im Rahmen ihrer Zusammenarbeit mit Novartis Technical Operations helfen die ISD-Teammitglieder der Produktionsdivision, Abläufe transparenter und effizienter zu machen. Dabei setzen sie zur Unterstützung der Alltagsarbeit an den verschiedenen Standorten Echtzeitdaten ein, um die standortspezifische Leistung zu analysieren, Risiken zu bewerten und Prognosen zu erstellen, die zu den richtigen Entscheidungen verhelfen sollen. Das System dürfte zu einer höheren Transparenz bei Produkten, Lagerbeständen und der allgemeinen Lieferkette beitragen. In ähnlicher Weise entwickelt das Team eine als Dynamo bezeichnete, KI-gestützte Lösung, um die Planung der Investitionen für klinische Studien zu verbessern. Dass Teams grob schätzen, wie hoch die Kosten künftiger Studien sind, und im Anschluss Jahr für Jahr von der Finanzabteilung eines Besseren belehrt werden, soll es von nun an nicht mehr geben. Stattdessen konzipiert das ISD-Team gemeinsam mit GDD Finance und der GDO-Funktion Algorithmen, die aus Ausgaben für frühere Studien und operativen Daten lernen und künftige Kosten vorhersagen.

«Dynamo ist unsere neueste Lösung im Rahmen des Nerve-Live-Programms. Mit Dynamo möchten wir erreichen, dass Algorithmen aufgrund der tatsächlichen Ausgaben in früheren Jahren Muster erkennen und dann im Hinblick auf neue Studien den Ausgabenverlauf prognostizieren. Ein anschliessender Vergleich soll den Mitarbeitenden ermöglichen, ihre Budgets besser zu planen», macht Luca Finelli deutlich.

Erweiterte Intelligenz

Finelli betont, dass das Ziel nicht darin bestehe, Mitarbeitende durch Supercomputer zu ersetzen. Vielmehr gehe es darum, sie bei ihren täglichen Arbeitsabläufen zu unterstützen und manuelle, träge und fehleranfällige Prozesse zu vermeiden. Aus diesem Grund missfällt Luca Finelli auch die übermässige Verwendung des Begriffs künstliche Intelligenz. Ihm zufolge lässt dieses Konzept fälschlicherweise an eine allmächtige digitale Instanz denken, die traditionelle Arbeitskräfte schon bald ersetzen und – vergleichbar mit den Zukunftsvisionen von Denkern wie Yuval Harari – unser Leben vollständig beherrschen könnte.

«Wir versuchen nicht, Menschen durch künstliche Intelligenz zu ersetzen», bemerkt Finelli. «Alle Hilfsmittel, die wir derzeit entwickeln, verhelfen den Menschen in Wirklichkeit zu mehr Effizienz in ihrem Job, damit sie die Informationen, die sie für die Planung und Umsetzung ihrer täglichen Abläufe benötigen, stets zur Hand haben.»

Genau das, betont Luca Finelli, verberge sich hinter dem Konzept der erweiterten Intelligenz, die seine Gruppe im gesamten Konzern einführen will. «Wir nutzen die Kraft von Daten, Datenwissenschaft und künstlicher Intelligenz, um die Intelligenz der Menschen zu erhöhen beziehungsweise zu erweitern, damit diese mehr Daten zur Verfügung haben und bessere Entscheidungen treffen können.»

Riesiges Potenzial …

Finelli ist überzeugt, dass die neuen KI-Systeme den Menschen helfen werden, schneller zu besseren Lösungen zu gelangen und die Effizienz durchwegs zu steigern.

«Angesichts der raschen Fortschritte im Bereich der KI sind wir inzwischen in ein Zeitalter eingetreten, in dem Wissen anders erzeugt wird als bisher», erläutert Luca Finelli. Waren früher noch Generationen von Wissenschaftlern erforderlich, um das Wissen der Menschheit zu erweitern, wächst dieser Fundus inzwischen nahezu in Sekundenschnelle.

«Wenn sich leistungsfähige Algorithmen für maschinelles Lernen und Deep Learning mit einem Problem befassen, können sie neue und bisweilen äusserst unerwartete Lösungen finden, die Erkenntnisgewinne und Leistungssteigerungen um stattliche 20 Prozent ermöglichen können.»

Als die KI-gestützte Software von DeepMind im Jahr 2015 erstmals einen Menschen beim Brettspiel Go schlug – was vor einem Jahrzehnt noch als nahezu unmöglich gegolten hatte –, war nicht nur die Überlegenheit des Systems bemerkenswert. Es entwickelte vielmehr Spielstrategien, die allgemeines Erstaunen hervorriefen. Seit damals haben KI-Systeme immer wieder gezeigt, dass sie Lösungen finden können, die dem menschlichen Einfallsreichtum bisher entgangen sind.

… und Risiken

KI hat aber auch deutlich gemacht, dass es vollständig verloren sein und mit falschen Lösungen aufwarten kann, insbesondere wenn die Datenqualität schlecht ist oder die Algorithmen inhärente, von ihren Entwicklern übersehene Verzerrungen aufweisen.

Kritisch äusserte sich unlängst Jonathan Zittrain, Professor an der Harvard Law School, als er eine deutliche Warnung aussprach und KI mit dem einstigen Brandschutzmaterial Asbest verglich, das bis zu den 1980er-Jahren, als dessen weltweit krebserregende Wirkung entdeckt wurde, in der Bauindustrie verwendet wurde.

«Maschinelles Lernen erinnert mich an Asbest», wurde er beim Precision-Medicine-Kongress 2018 in Boston von der US-News-Website für Medizin, Stat, zitiert. «Am Ende ist es überall – sogar da, wo es eigentlich gar nicht sein sollte. Und möglicherweise sind mit maschinellem Lernen einige latente Nebenwirkungen verbunden, die sich später, wenn sie sich nicht mehr vollständig ausmerzen lassen, als bedauerlich erweisen.»

Besonders beunruhigt Zittrain, dass neue digitale Systeme bei der Diagnose von Patienten falsche Schlüsse ziehen und ungeeignete Therapien vorschlagen könnten. Obwohl sich das ISD-Team eher mit operativen als mit klinischen und patientenspezifischen Daten befasst, weiss der Konzern nur zu gut, dass KI-Tools wie maschinelles Lernen und die neuronalen Netzwerke des Deep Learning – die Daten eigenständig auswerten und selbst für Experten kaum zu durchschauen sind – eigene inhärente Risiken mit sich bringen.

«Wenn die Daten, mit denen wir künstliche Intelligenz zum Lernen füttern, Lücken oder Fehler enthalten, werden die Algorithmen falsch lernen und die fehlenden Inhalte ausklammern. Das Ergebnis wird zwangsläufig mangelhaft sein», stellt Finelli klar.

Um das zu vermeiden, entwickeln Luca Finelli und sein Team Dr. Agent (Kurzform für Data Readiness Agent). «Diese Anwendung durchforstet alle in unserer Nerve- Live-Plattform gespeicherten Daten fortwährend nach Unregelmässigkeiten. Im Anschluss werden die Daten anhand bestimmter Regeln analysiert, um die bestmögliche Qualität und Kompatibilität mit unserem ‹Datensee› (Data Lake) sicherzustellen.»

Finelli will auch Fehler vermeiden, die nicht sofort ins Auge springen. «Wann immer ein bestimmter Datensatz ausgewählt oder ein spezifischer Algorithmus programmiert wird, kann dieser mit einer Reihe von Beschränkungen oder Sachzwängen einhergehen, die im Datengenerierungsprozess oder in der Algorithmusarchitektur selbst schlummern. Im Fachjargon bezeichnet man dies als ‹Selektionsverzerrung›. Mit anderen Worten sind die Daten nicht repräsentativ für die zu analysierende Population und erfassen nur bestimmte Aspekte der untersuchten Objekte.»

Verantwortungsbewusstsein und Ethik

Das ISD-Team, das inzwischen in die Konzeptionsphase von Dr. Agent eingetreten ist, möchte, dass das System auch seine inhärenten Grenzen und Verzerrungen kennt.

«Wir haben die grosse Verantwortung, konstant unsere Daten zu überprüfen», macht Finelli deutlich. «Das müssen sowohl die Datenexperten als auch die Unternehmen ernst nehmen. Wir müssen unsere Daten und Algorithmen äusserst sorgfältig testen, um sicherzugehen, dass die Ergebnisse nicht verzerrt sind und wir nicht zu falschen Schlüssen gelangen.»

Da KI-gestützte Systeme immer komplexer werden und sich gerade zu einem wesentlichen Input der Entscheidungsfindung entwickeln, gewinnt auch die Ethik an Bedeutung. «Wir machen uns ebenfalls sehr viele Gedanken über ethische Fragen. Wir wollen sicherstellen, dass wir Ungereimtheiten und Verzerrungen vermeiden, die sich bei der Auswahl und Strukturierung unserer Daten ergeben können. Andernfalls nutzen wir unter Umständen nicht das volle Potenzial künstlicher Intelligenz und verpassen eine Chance, die wir möglicherweise so schnell nicht wieder bekommen.»

Das Verfehlen des eigenen Potenzials kann nicht nur zu nachlassendem öffentlichem Interesse führen. Es kann auch Investoren abschrecken und damit die grosse Hoffnung der Menschen enttäuschen, dass KI die Performance in den nächsten Jahren merklich steigert.

Derartige Bedenken sind nicht von der Hand zu weisen. Als KI-Forscher in den 1970er-Jahren philosophierten, sie seien bald in der Lage, Computer mit menschlicher Intelligenz zu bauen, horchten Investoren weltweit auf. Doch als sich dieses Versprechen als Trugschluss entpuppte, wandte sich der Markt ab. Es folgte eine Phase mit niedrigen Investitionen und begrenzter Forschung – der sogenannte KI-Winter.

«Wenn KI die falschen Ergebnisse liefert, könnte wieder ein solcher ‹Winter› anstehen», warnt Finelli. Systeme wie Dr. Agent dürften derartige Risiken allerdings in Schach zu halten vermögen, fügt er hinzu.

Vielen Dank für das Lesen des Live Magazins

Bleiben Sie auf dem Laufenden, indem Sie unseren Newsletter abonnieren.

AbonnierenMit dem Absenden Ihrer E-Mail erklären Sie sich damit einverstanden, dass die Novartis AG Ihre E-Mail-Daten für den internen Gebrauch von Novartis, in Übereinstimmung mit unserer Datenschutzrichtlinie und mit geschützten technischen Mitteln erfasst und verarbeitet.